Introducción

Desde la primera Revolución Industrial con la máquina de vapor, pasando por la producción en masa, la automatización y la digitalización facilitadas por la Internet, hasta la actual Industria 5.0, las tecnologías han transformado profundamente la producción, la comunicación y la enseñanza. La Industria 5.0, centrada en la colaboración entre los seres humanos y las máquinas, se destaca por integrar la inteligencia artificial (IA) en procesos productivos y educativos, de manera más inteligente y sostenible (figura 1).

Fuente: Servnivel3, 2022.

En este contexto, la IA emerge como un motor de la innovación educativa, ofreciendo herramientas que permiten una enseñanza más adaptada a las necesidades de los estudiantes, y fomentando la reflexión sobre los principios éticos, la sostenibilidad y la autonomía en entornos cada vez más automatizados.

El panorama conceptual e histórico

La IA se define como un conjunto de modelos computacionales y algoritmos que permiten reconocer patrones, inferir información y actuar a partir de datos, desde sistemas expertos hasta generadores de texto e imágenes. Su evolución de enfoques basados en reglas a redes neuronales y aprendizaje profundo ha permitido automatizar tareas y optimizar procesos, en distintos ámbitos. Las sucesivas revoluciones industriales han impulsado avances tecnológicos rápidos, y cada una ha sentado las bases para la siguiente, desde la mecanización hasta los sistemas ciberfísicos actuales.

Estos desarrollos han generado máquinas complementarias al ser humano, que son capaces de delegar ciertas funciones cognitivas y físicas, como la memoria, la orientación o la toma de decisiones. La combinación de biología y tecnología, presente en sistemas híbridos o implantes cibernéticos, permite emular algunos procesos del cerebro, si bien la reflexión ética y la autonomía continúan siendo exclusivamente humanas.

Desde esta perspectiva, surge la necesidad de abordar las implicaciones filosóficas que tiene la IA en la educación, en especial, en torno al conocimiento, la responsabilidad y la autonomía de los estudiantes y los docentes.

Las implicaciones filosóficas

La integración de la IA en la educación plantea desafíos de fondo:

- La epistemología y la autoridad del conocimiento: los sistemas de la IA procesan datos a gran velocidad y generan conclusiones, sin seguir métodos tradicionales, cuestionando la legitimidad de la información y exigiendo una epistemología digital, que considere a la IA como un actor en la producción de conocimiento, bajo criterios de claridad, reproducibilidad y evaluación crítica (Pérez, 1989; Conill, 2019).

- La responsabilidad moral y la agencia: la IA carece de conciencia e intencionalidad; la responsabilidad recae en quienes la diseñan, implementan y supervisan. Los sesgos y limitaciones reflejan decisiones humanas y condiciones socioeconómicas, que tienen un impacto directo en los resultados. Su uso debe fomentar la reflexión crítica y preservar la autonomía cognitiva de los estudiantes y los docentes (López de Mántaras, 2015).

- La condición humana y la autonomía: delegar procesos, de forma excesiva, en la IA puede derivar en un “sedentarismo cognitivo”, que afecta la memoria y el pensamiento reflexivo. Aunque estas tecnologías mejoran el acceso y la equidad, un uso utilitarista puede comprometer la privacidad y la autonomía. Es esencial que los sistemas fomenten la reflexión crítica y mantengan el equilibrio entre beneficios colectivos e individuales (Klimova, Pikhart y Kacetl, 2023).

Estas tensiones ponen de relieve la urgencia de crear marcos normativos y pedagógicos, que garanticen que la IA complemente, y no sustituya, las capacidades humanas, en consonancia con los principios internacionales que promueven una IA centrada en el ser humano.

Los beneficios para el aprendizaje

Las aplicaciones de la IA en educación ofrecen beneficios potenciales:

- Personalización: los sistemas de tutoría inteligente adaptan contenidos y niveles de dificultad al perfil del estudiante, mejorando, así, la retención y el logro de objetivos.

- Eficiencia administrativa: la automatización de inscripciones, informes y notificaciones agiliza la gestión, siempre bajo supervisión humana y normativa vigente (LOPDGDD, Reglamento de IA de la UE).

- Retroalimentación inmediata: plataformas como Knewton ofrecen respuestas en tiempo real, que favorecen la autorregulación del aprendizaje y alivian la carga del docente.

- Innovación curricular: la IA apoya modelos basados en competencias, con progresión flexible y recursos adaptados a cada contexto (Patrick y Sturgis, 2017).

- La efectividad de la IA requiere marcos normativos sólidos, transparencia, evaluación ética y cooperación internacional, tal como subraya la UNESCO (2022).

La sostenibilidad y las tensiones de la IA

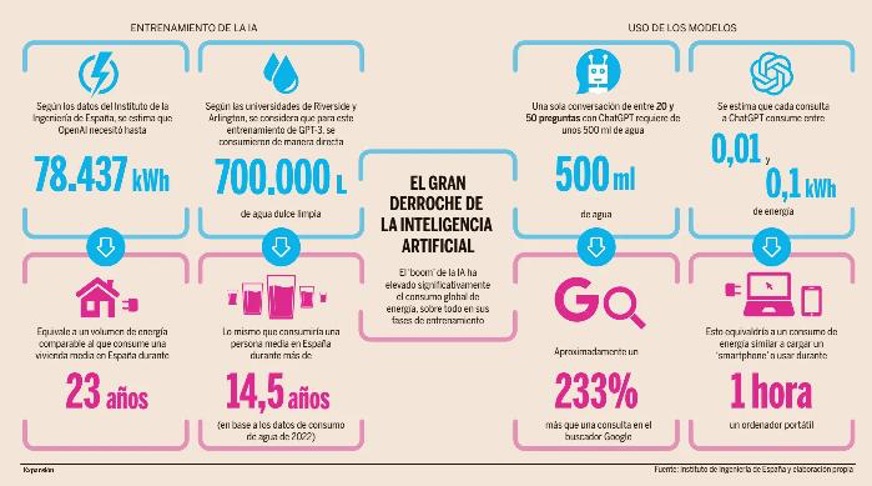

El despliegue masivo de la IA reabre el debate sobre su huella ambiental. La expansión de la IA generativa aumenta, de forma significativa, el consumo de energía y agua en centros de datos, como muestra la figura 2, lo que evidencia la necesidad de integrar criterios de eficiencia y sostenibilidad en su diseño, operación y regulación.

Fuente: Imagen reproducida en Juste (2024).

La creación y la destrucción de valor sostenible

Además del alto consumo energético, la IA puede generar beneficios ambientales y sociales mediante la optimización de recursos en centros de datos; por ejemplo, el uso de técnicas de modelado y hardware más eficiente, como las implementadas en entrenamientos de modelos con AlphaZero, el desarrollo de alternativas alimentarias vegetales (NotCo) o las mejoras en la detección temprana de enfermedades (Nanox.AI), contribuyendo, de esta manera, a una atención sanitaria más eficiente y sostenible. Sin embargo, los efectos negativos también son relevantes: los fallos de sistemas autónomos como los robotaxis de Cruise y Waymo aumentan la congestión y el consumo; el entrenamiento de modelos generativos sigue implicando altos niveles de emisiones y uso de agua. La Agencia Internacional de la Energía (2023) proyecta que, para 2028, los centros de datos podrían consumir más de 325 TWh anuales, superando a países como Italia o Reino Unido.

Los desafíos y los riesgos prácticos en la educación

- Privacidad y seguridad de datos: la educación maneja información sensible. El Reglamento (UE) 2024/1689 sobre la IA complementa el RGPD, estableciendo requisitos de anonimización, minimización y supervisión rigurosa.

- Transparencia y explicabilidad: la UNESCO (2021) señala la rendición de cuentas y la supervisión humana como pilares de la ética en el uso de la IA. Si bien la transparencia es una exigencia central en la mayoría de los marcos éticos internacionales (Jobin et al., 2019), la explicabilidad se complica debido a la complejidad técnica de los modelos avanzados y, en ocasiones, a la opacidad deliberada, que se deriva del secreto industrial.

- Propiedad intelectual y autoría: es esencial establecer marcos normativos y protocolos institucionales para el uso, citación y revisión de materiales generados por la IA, con el fin de proteger los derechos de autor, sin limitar el aprovechamiento pedagógico de la tecnología. Un ejemplo ilustrativo es la demanda presentada por un grupo de 40 periódicos franceses, encabezados por Libération, contra la web de noticias News.dayFr.com. Este caso pone de manifiesto las consecuencias derivadas de la ausencia de regulaciones claras.

- Sesgo algorítmico y equidad: entrenar algoritmos con datos no equilibrados puede reproducir desigualdades de género, culturales o socioeconómicas. Para mitigar este riesgo, la legislación y las directrices éticas recomiendan diversificar los datos, mantener supervisión humana, realizar auditorías periódicas y formar a docentes y estudiantes en la identificación de dichos sesgos (Best Schools in Spain, 2023).

- Desigualdades territoriales y de infraestructura: la introducción de la IA en contextos con brechas históricas requiere garantizar conectividad, disponibilidad de recursos tecnológicos y acceso a datos abiertos. También es importante proporcionar condiciones materiales adecuadas para el uso de la tecnología (Colombia 4.0, Agenda Uruguay Digital 2020).

La IA puede generar beneficios ambientales y sociales mediante la optimización de recursos en centros de datos.

El marco normativo y los principios orientadores

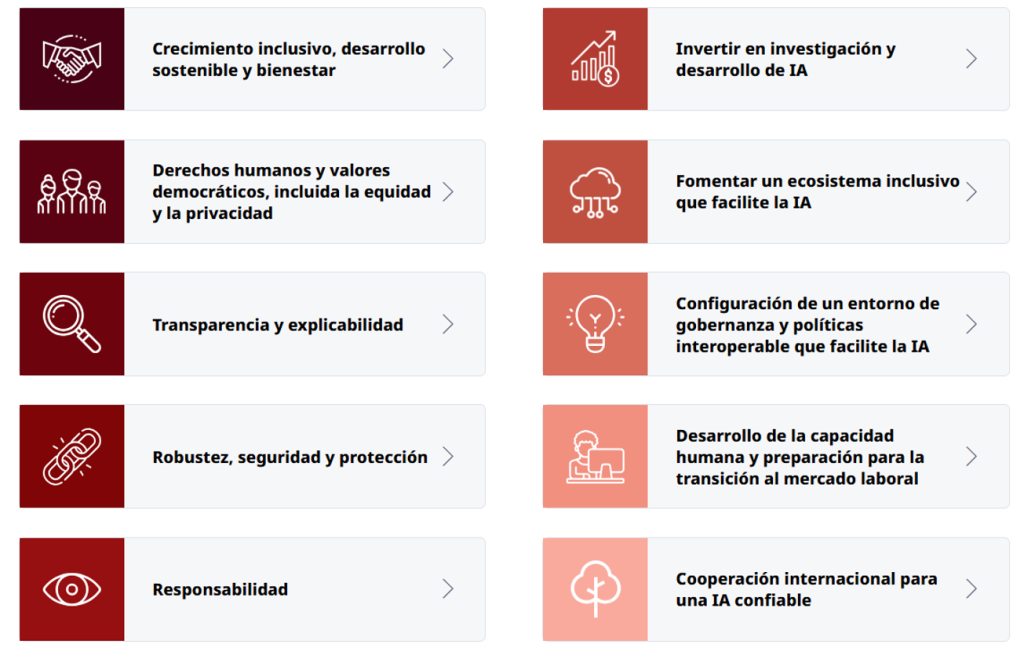

Los OECD AI Principles (2019, 2024) constituyen una referencia clave para un desarrollo de la IA confiable, ético y centrado en las personas. Se organizan en dos ejes: por un lado, principios de valor que promueven la inclusión, la sostenibilidad, el respeto a los derechos humanos, la transparencia, la seguridad y la rendición de cuentas; por otro, recomendaciones de política que impulsan inversión en I+D, ecosistemas inclusivos, marcos de gobernanza interoperables, capacitación para el empleo y cooperación internacional. La Figura 3 ilustra estos principios de manera resumida, mostrando tanto los valores fundamentales como las recomendaciones para los responsables de las políticas mencionadas.

Fuente: OCDE (2019).

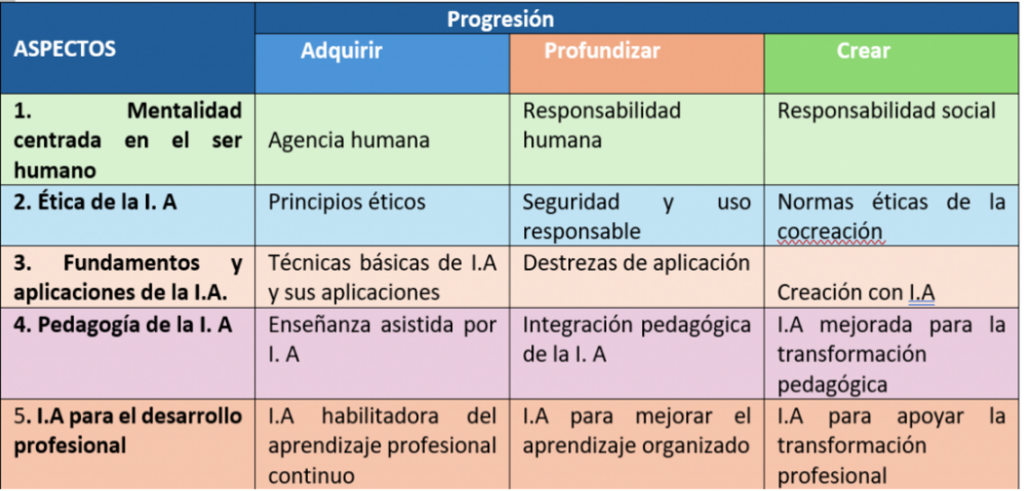

La UNESCO complementa este marco con instrumentos específicos para la educación. El AI Competency Framework for Teachers guía la formación docente, por medio de cinco áreas y tres niveles de progresión, promoviendo un uso ético, eficaz y pedagógicamente relevante de la IA en el aula. La Figura 4 presenta estas áreas y niveles de manera visual.

Fuente: UNESCO, Miao y Cukurova, 2025.

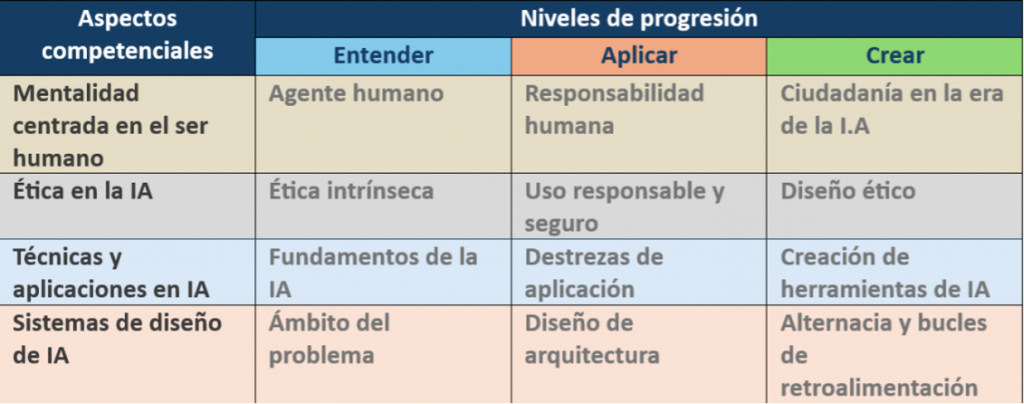

A su vez, el AI Competency Framework for Students (Figura 4) se centra en el pensamiento humano, la ética, los fundamentos técnicos y la creatividad en el diseño de sistemas de la IA, orientando a los estudiantes hacia un uso responsable y crítico de esta tecnología.

Fuente: Miao, Shiohira y Lao, 2025.

Estos marcos se complementan con la recomendación sobre la ética de la inteligencia artificial (2021) y el Consenso de Beijing sobre IA y Educación (2010), que enfatizan la integración curricular, la reducción de sesgos y la promoción de prácticas responsables.

A nivel regional, la Unión Europea avanza en dos frentes: el EU AI Act (2024), que clasifica los sistemas utilizados en educación, como los de evaluación y admisión, como de alto riesgo, sometiéndolos a obligaciones de transparencia y supervisión humana; y el borrador Empowering Learners for the Age of AI (European Commission / OECD, 2025), que propone un marco común de alfabetización en la IA para primaria y secundaria. En España, estas orientaciones se incorporan mediante el Marco de Referencia de la Competencia Digital Docente (MRCDD, 2022) y la Guía INTEF (2024), que incluyen indicadores de ética, protección de datos y formación continua del profesorado.

Estos instrumentos convergen en principios fundamentales: la IA centrada en la persona, el uso ético, la transparencia, la fiabilidad y la sostenibilidad, ofreciendo recomendaciones concretas para la formación docente, la gestión institucional y la protección de estudiantes frente a riesgos asociados al uso de la IA.

Entrenar algoritmos con datos no equilibrados puede reproducir desigualdades de género, culturales o socioeconómicas.

Recomendaciones para la práctica educativa

La rápida expansión de la inteligencia artificial no se refleja plenamente en el ámbito educativo, donde predomina un enfoque técnico que limita su potencial pedagógico, ético y sostenible. Además, persisten desafíos como la formación crítica insuficiente de docentes y estudiantes, las brechas en la alfabetización algorítmica, la ausencia de marcos normativos robustos y las desigualdades tecnológicas que profundizan la exclusión. Para superarlos, se requiere un enfoque integral que combine la relevancia pedagógica, la ética y la sostenibilidad:

- Integrar marcos internacionales y regionales en la formación docente. El currículo ofrece una guía clara para implementar prácticas educativas inclusivas, transparentes y sostenibles, fomentando un uso reflexivo de la inteligencia artificial, que tenga impactos positivos en la sociedad y el medioambiente(UNESCO 2024).

- La alfabetización crítica en la IA va más allá del simple uso de herramientas. Implica comprender algoritmos, evaluar riesgos y reflexionar sobre los impactos éticos y sociales que tiene el uso de la IA, promoviendo interacciones responsables y fortaleciendo la autonomía cognitiva y la toma de decisiones informadas de los estudiantes (World Economic Forum (2025); AILit Framework (Comisión Europea & OCDE, 2025)

- El uso de la IA conlleva un consumo energético elevado, tanto en el entrenamiento como en la operación de modelos. Para minimizar su impacto, se recomienda emplear modelos más eficientes, hardware optimizado, energías renovables y colaboración abierta, garantizando además la protección de datos y el uso ético de la tecnología(Agencia Internacional de la Energía; IBM, 2024).

- Diseñar currículos que permitan la co-creación de contenidos facilita la implementación progresiva de aprendizajes, la dedicación a áreas clave y la evaluación integrada de competencias, habilidades y actitudes, promoviendo, así, la participación activa de los docentes y los estudiantes (UNESCO, 2023).

- Para que la IA transforme la educación de manera efectiva, es esencial integrarla en procesos formativos reflexivos, contextualizados y centrados en el desarrollo humano. Esto requiere un seguimiento constante de sus efectos sobre el aprendizaje, la equidad, la ética y el entorno social, asegurando ajustes oportunos y decisiones informadas (Tuomi, 2018).

Reflexión final

La inteligencia artificial ofrece oportunidades significativas para personalizar el aprendizaje y mejorar la eficiencia, siempre y cuando su integración respete los criterios éticos, pedagógicos y sostenibles; complemente las capacidades humanas; y monitoree continuamente su impacto ambiental, social y cognitivo.